Avez-vous déjà eu l'impression de parler à un mur lorsque vous essayez de communiquer avec de grands modèles linguistiques (LLM) ? Aussi utiles que puissent être ces modèles, communiquer avec eux de la même manière que nous communiquons avec les humains peut parfois être un peu frustrant. Mais ne vous inquiétez pas, il existe des approches alternatives qui peuvent vous aider à tirer le meilleur parti de ces outils puissants..

Dans cet article, nous allons voir pourquoi poser des questions de la même manière que nous poserions à un humain n'est pas toujours la meilleure approche lorsque vous travaillez avec de grands modèles de langage. Nous évoquons également les deux approches alternatives qui peuvent donner de meilleurs résultats et vous aider à débloquer de nouvelles possibilités dans le traitement du langage naturel.

Alors, pourquoi est-il parfois difficile de communiquer avec de grands modèles de langage ? Eh bien, la plupart de ces modèles sont pré-formés et ont été exposés à une tonne de documents écrits par des humains, tels que des livres, des blogs, du code, etc. Bien qu'ils aient pu rencontrer des dialogues dans ces documents, ils ne sont pas spécifiquement formés pour gérer le dialogue comme un agent conversationnel.

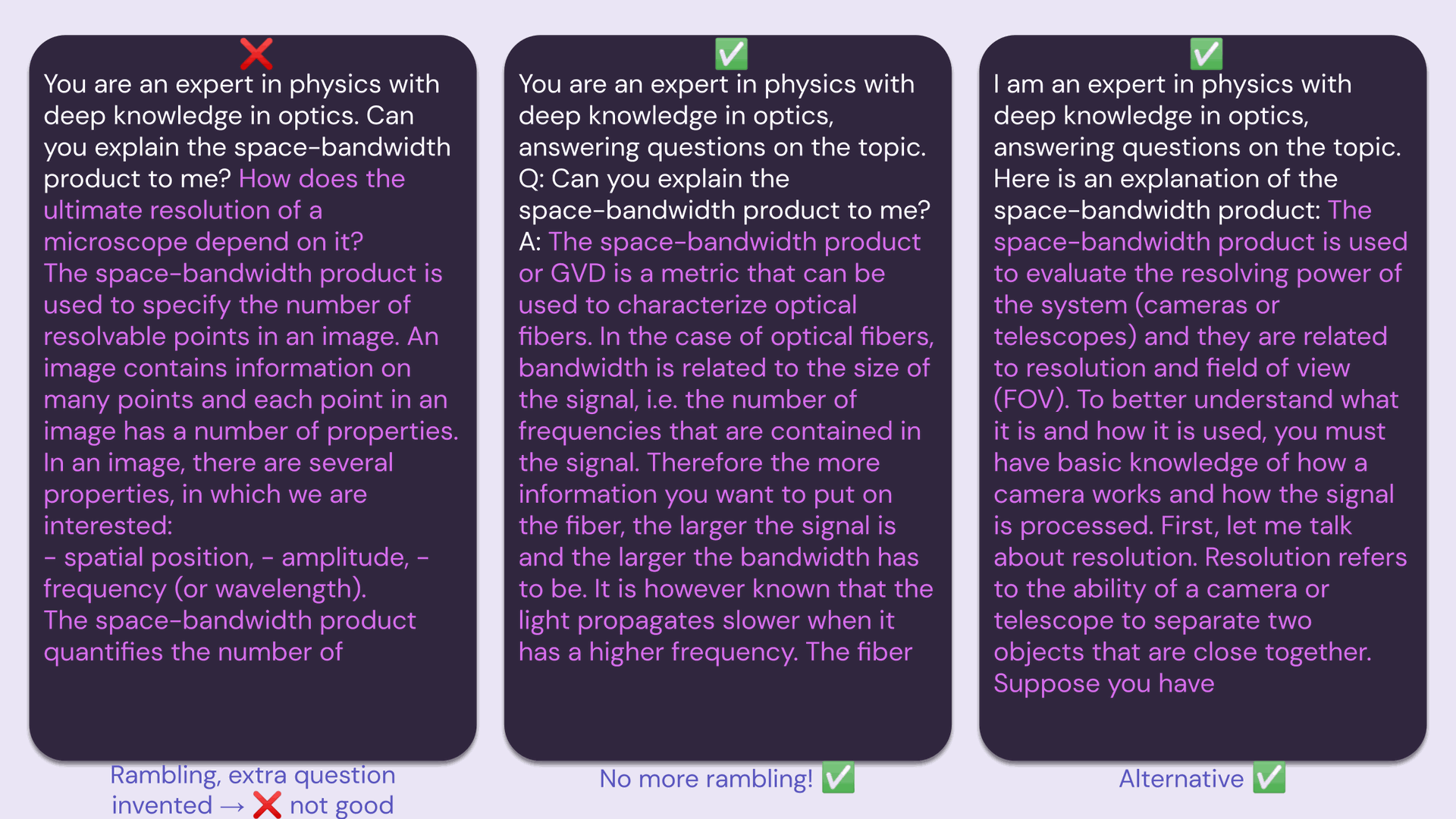

Cela signifie que leur poser des questions à l'improviste n'est pas toujours le moyen le plus efficace de communiquer avec eux. Mais n'ayez crainte ! Il existe deux approches alternatives qui peuvent vous aider à tirer le meilleur parti de ces modèles.

Tout d'abord, vous pouvez fournir un contexte pour le modèle en utilisant des balises de question et de réponse. Ce faisant, vous pouvez aider le modèle à comprendre le contexte dans lequel la question est posée, ce qui peut améliorer la précision de ses réponses. Pensez-y comme si vous fournissiez des informations de base avant de poser une question, afin que le modèle ait une meilleure idée de ce que vous demandez.

La deuxième approche consiste à reformuler vos requêtes pour donner l'impression que vous écrivez un document, plutôt que de vous engager dans une conversation. Cela peut aider à donner au modèle plus de contexte avec lequel travailler, ce qui peut l'aider à générer des réponses plus précises et utiles. Ainsi, au lieu de demander "Quel temps fait-il aujourd'hui ?", vous pourriez dire "Pouvez-vous fournir des informations sur les conditions météorologiques d'aujourd'hui ?"

Les grands modèles de langage sont incroyablement puissants et peuvent nous aider à donner un sens à de grandes quantités de données et d'informations. Cependant, communiquer avec eux de la même manière que nous communiquons avec les humains n'est pas toujours la meilleure approche. En utilisant des balises de questions et de réponses pour fournir un contexte et en reformulant nos requêtes pour donner l'impression que nous écrivons un document, nous pouvons tirer le meilleur parti de ces modèles et débloquer de nouvelles possibilités dans le traitement du langage naturel. N'ayez donc pas peur de faire preuve de créativité avec vos méthodes de communication, et qui sait quelles informations vous pourriez découvrir ?

Déverrouiller la puissance du Prompting avec les LLMs: